发布时间:2025-11-26 阅读量:633 来源: 发布人: suii

近期,摩根大通一份报告引发广泛关注,其预测AI领域在未来五年将产生高达5万亿美元的融资需求,核心投向正是AI算力基础设施的扩张。在这一轮浪潮中,超大规模数据中心成为资金吸纳的主体。当业界普遍将目光聚焦于GPU算力芯片时,一个关键组件正扮演着愈发重要的“幕后英雄”——DDR5内存。它正从单纯的数据存储单元,蜕变为决定AI算力效率的核心驱动力。

一、 算力瓶颈的转移:当“内存墙”成为AI的枷锁

1.带宽倍增:DDR5将数据预取位数从8bit提升至16bit,核心基础频率也大幅提高。这使得单根DDR5内存条的带宽相比DDR4轻松实现翻倍,从每秒数十GB提升至上百GB。对于需要吞吐海量数据的AI应用而言,这意味着通往算力核心的“数据高速公路”被显著拓宽。

2.容量显著提升:DDR5引入了创新的决策反馈均衡器技术并改善了信号完整性,支持更高密度的内存颗粒。单条LRDIMM内存的容量可突破256GB,甚至向512GB迈进。这为在内存中直接容纳超大型AI模型提供了可能,极大减少了与慢速存储(如SSD)之间的数据交换,从而加速训练与推理过程。

3.能效优化与稳定性增强:DDR5将供电管理单元从主板移至内存条本身,采用了片上稳压器设计。此举不仅降低了信号噪声、提升了电源稳定性,还实现了更精细的功耗控制。对于电费构成主要运营成本的数据中心来说,DDR5在提供极致性能的同时,有助于降低整体TCO,符合绿色计算的发展趋势。

三、 协同进化:DDR5与AI芯片架构的深度融合

•与GPU的协同:虽然GPU普遍搭载了更高速的HBM,但其成本极高,容量有限。DDR5则作为性价比极高的“主内存”,承担起为多个GPU高效供应数据的任务。高带宽的DDR5确保了CPU能快速将任务数据分发至各GPU,并收集处理结果,避免了因系统内存瓶颈造成的GPU算力浪费。

•与CPU的协同:新一代支持DDR5的服务器CPU(如Intel至强可扩展处理器、AMD霄龙处理器)均配备了更多内存通道,与DDR5的高带宽特性完美匹配,共同构建了强大的数据处理平台,有效支撑了AI推理、数据分析等关键业务。

结语:迈向智能算力时代的基础支柱

4月2日,兆易创新宣布正式发布新一代SPI NAND Flash产品GD5F4GM7/GD5F8GM8。

标普全球Visible Alpha研究主管Melissa Otto指出,当前推动股市创纪录上涨的人工智能巨额投资正面临显著挑战,主要由于中东危机对全球经济增长前景与能源成本带来不确定性影响。

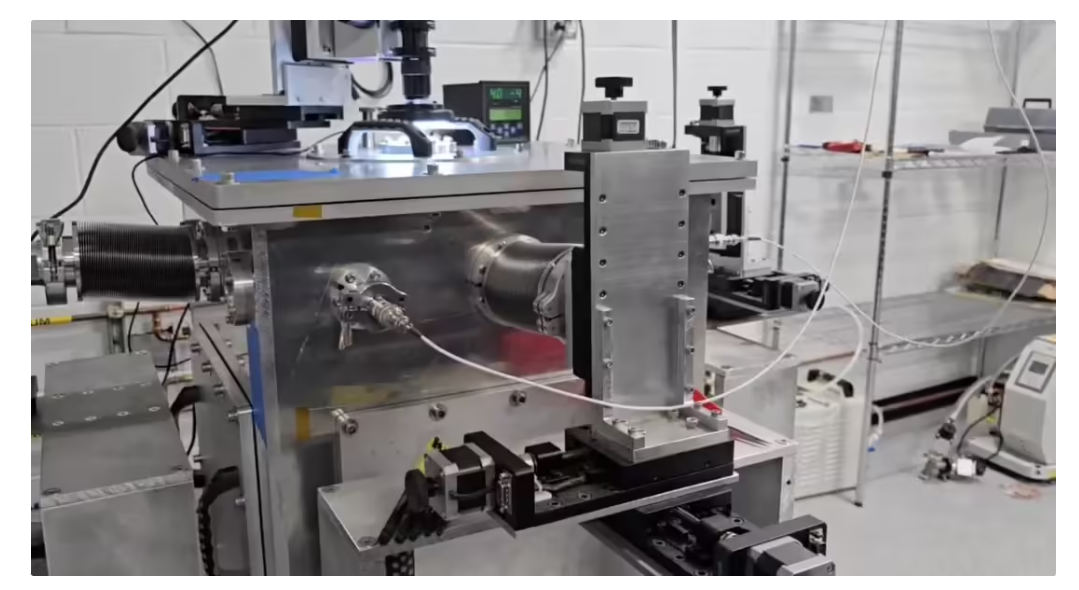

南加州大学团队研发新型存储芯片,可在 700°C 高温下稳定运行,且未出现性能退化迹象。

联发科和高通已开始下修于晶圆代工厂的4nm投片量,显示手机链景气明显降温

EM8695 RedCap模块基于Qualcomm SDX35基频处理器,为无需传统5G全速率或复杂功能的应用提供精简型5G解决方案